ضبط أداء النماذج اللغوية LLM Fine-tuningبتقنيات LoRA

ضبط أداء النماذج اللغوية LLM Fine-tuningبتقنيات LoRA

وصف الخدمة

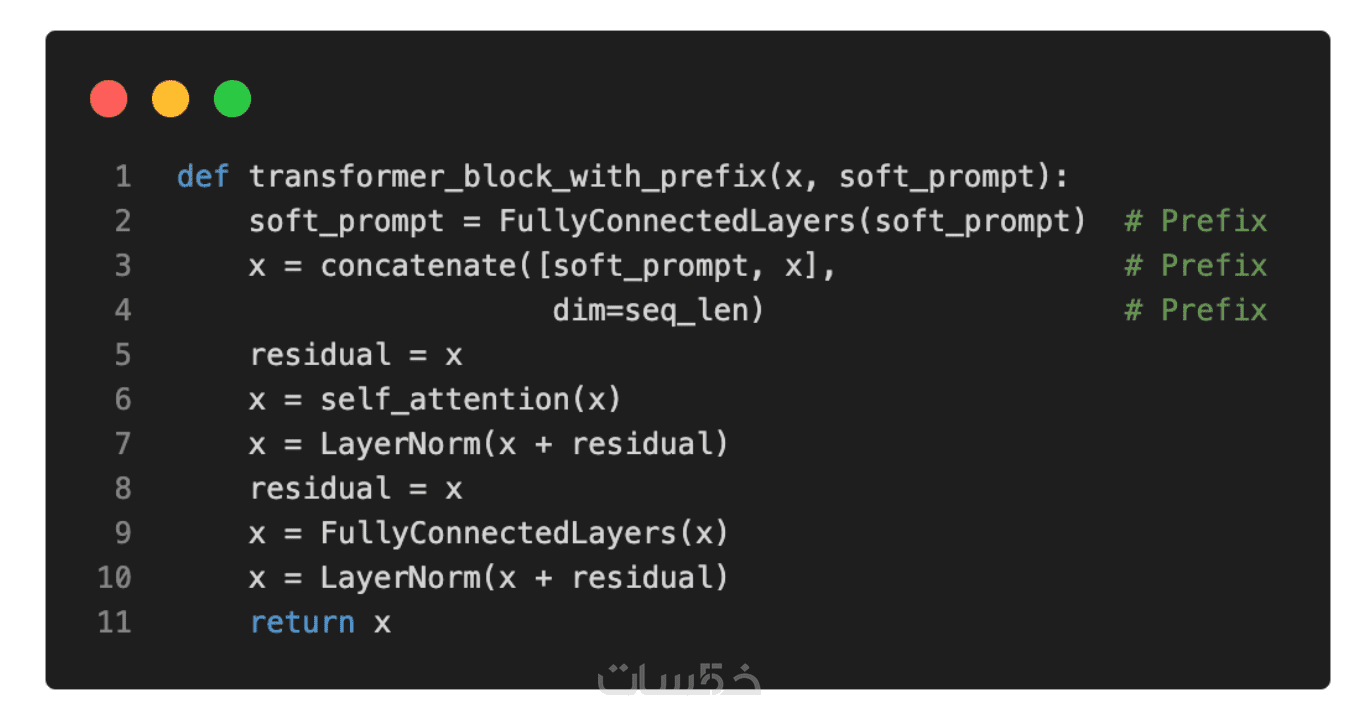

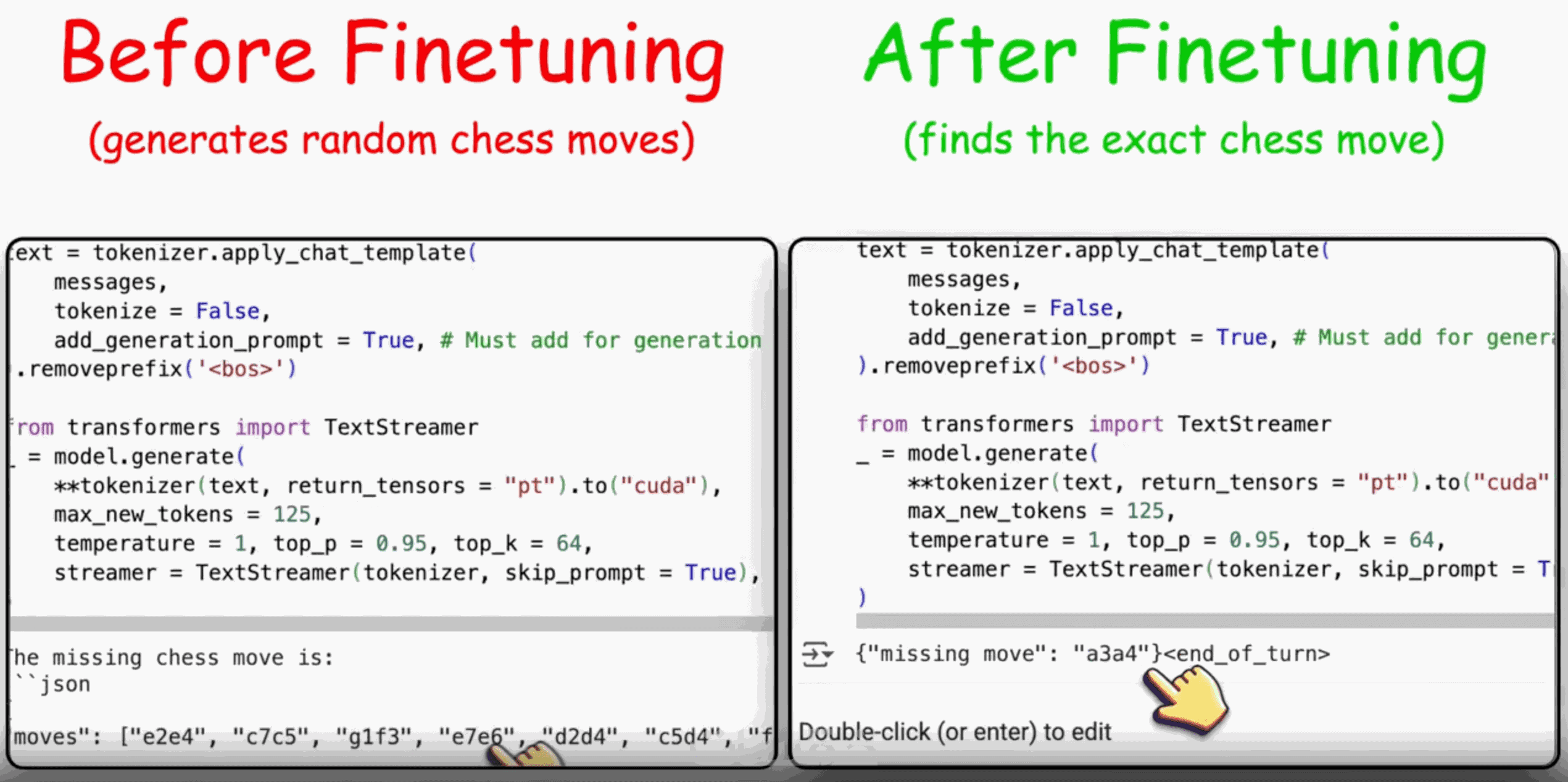

سأقوم بعمل الضبط الدقيق (Fine-Tuning) لنموذج لغة كبير (مثل Llama 3 أو Mistral أو Falcon) على مجموعة بياناتك الخاصة باستخدام تقنيات LoRA / PEFT لتحقيق أداء عالٍ مع استهلاك منخفض للذاكرة.

الخدمة الأساسية تشمل:

-إجراء Fine-Tuning لنموذج لغة كبير مفتوح المصدر (مثل Llama 3 أو Mistral أو Falcon) بحجم حتى 7B parameters باستخدام تقنية LoRA / PEFT.

-استخدام Dataset خاصة بالعميل بحجم أقصى 1000 مثال تدريبي (instruction / input-output pairs).

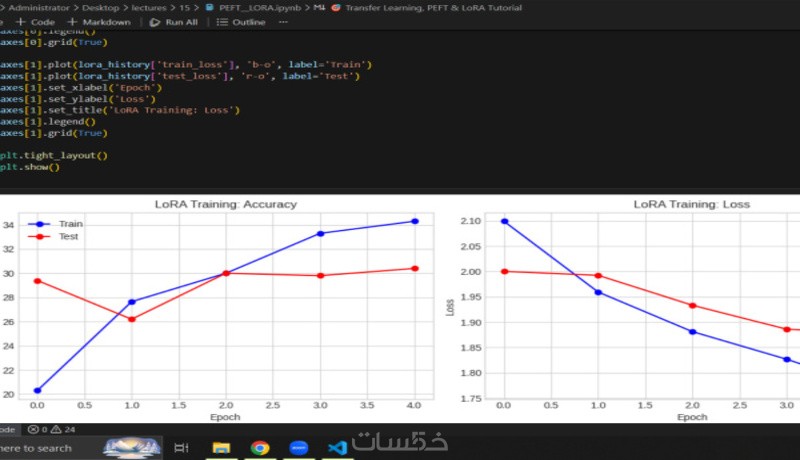

-تنفيذ التدريب بعدد 3 epochs باستخدام إعدادات محسّنة لتحقيق أفضل توازن بين الأداء واستهلاك الموارد.

-تجهيز Dataset وتحويلها إلى الصيغة المناسبة للتدريب (JSON / JSONL).

تسليم الملفات التالية:

-ملفات LoRA Adapter النهائية

-كود التشغيل والاستدلال (Inference script)

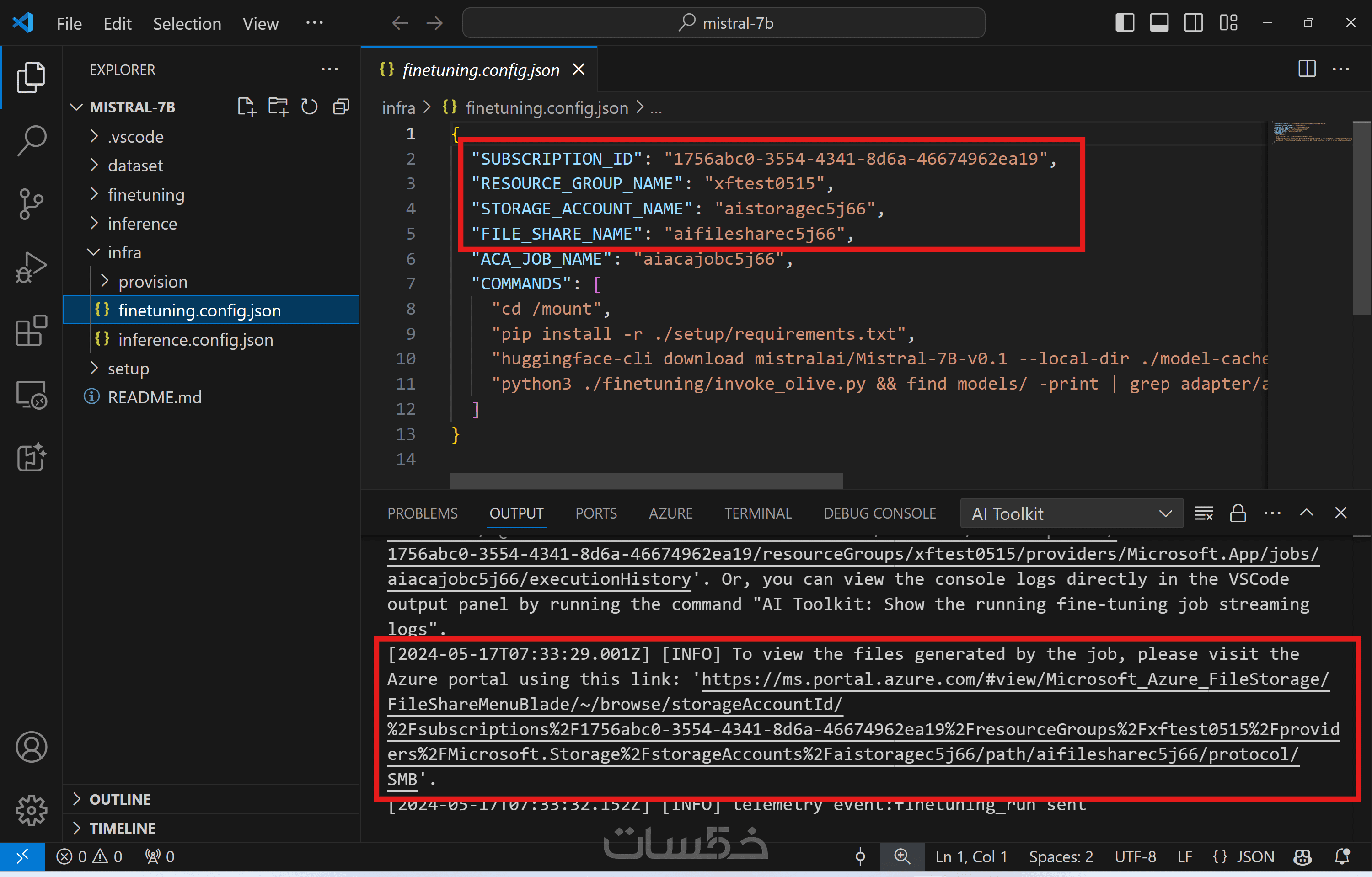

-ملف إعدادات التدريب (config file)

-شرح لطريقة تشغيل النموذج

مميزات الخدمه

1- Fine-Tuning باستخدام LoRA لتقليل استهلاك VRAM

2- دعم Dataset حتى 1000 مثال

3- تحسين أداء النموذج لمهمة محددة

4- إعداد كامل باستخدام HuggingFace و PEFT

5- اختبار النموذج قبل التسليم

6- كود جاهز لتشغيل النموذج

7- تنظيم Dataset بالشكل الصحيح

ما الذي ستستلمه

عند الانتهاء ستحصل على:

ملفات LoRA Adapter النهائية

كود تشغيل النموذج (Inference script)

ملف إعدادات التدريب (config file)

Dataset بعد تحويلها للصيغة الصحيحة

مثال عملي لتشغيل النموذج

شرح بسيط لطريقة الاستخدام والتشغيل