سأقوم ببناء Data Pipeline باستخدام Python لاستخراج وتحويل بياناتك إلى نظام منظم

سأقوم ببناء Data Pipeline باستخدام Python لاستخراج وتحويل بياناتك إلى نظام منظم

وصف الخدمة

هل تعاني من التعامل اليدوي مع البيانات وتكرار نفس الخطوات يوميًا؟

هل لديك بيانات من مصادر مختلفة وتريد تنظيمها بشكل تلقائي وبدون أخطاء؟

أقدّم لك خدمة إنشاء Data Pipeline احترافي باستخدام Python (ETL) لتحويل بياناتك إلى نظام منظم يعمل تلقائيًا بكفاءة.

ماذا تتضمن الخدمة الأساسية؟

تشمل الخدمة الأساسية العمل على:

ملف بيانات واحد

حتى 5,000 صف بيانات (Rows)

أو حجم ملفات يصل إلى 10 MB

وسأقوم بـ:

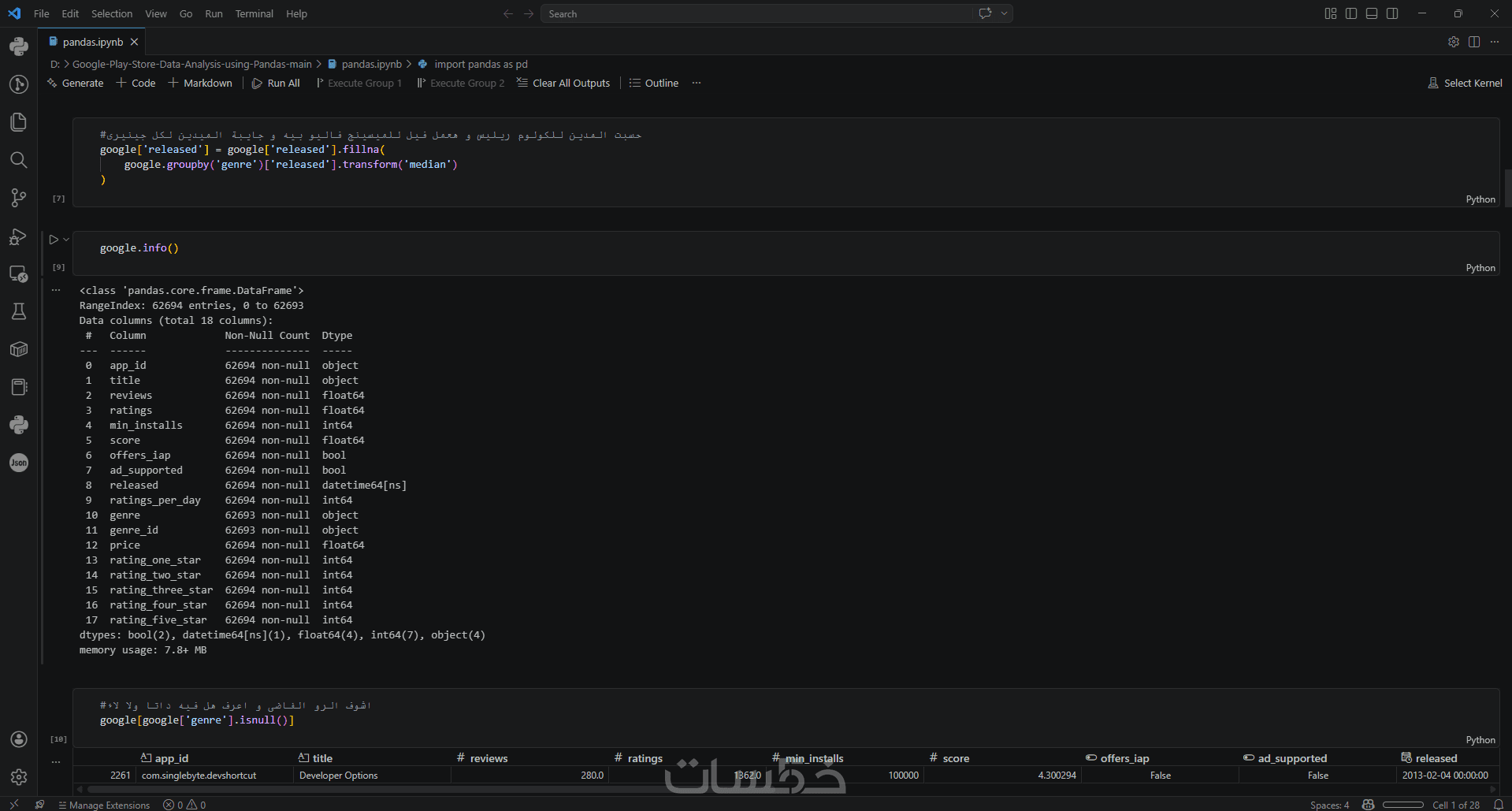

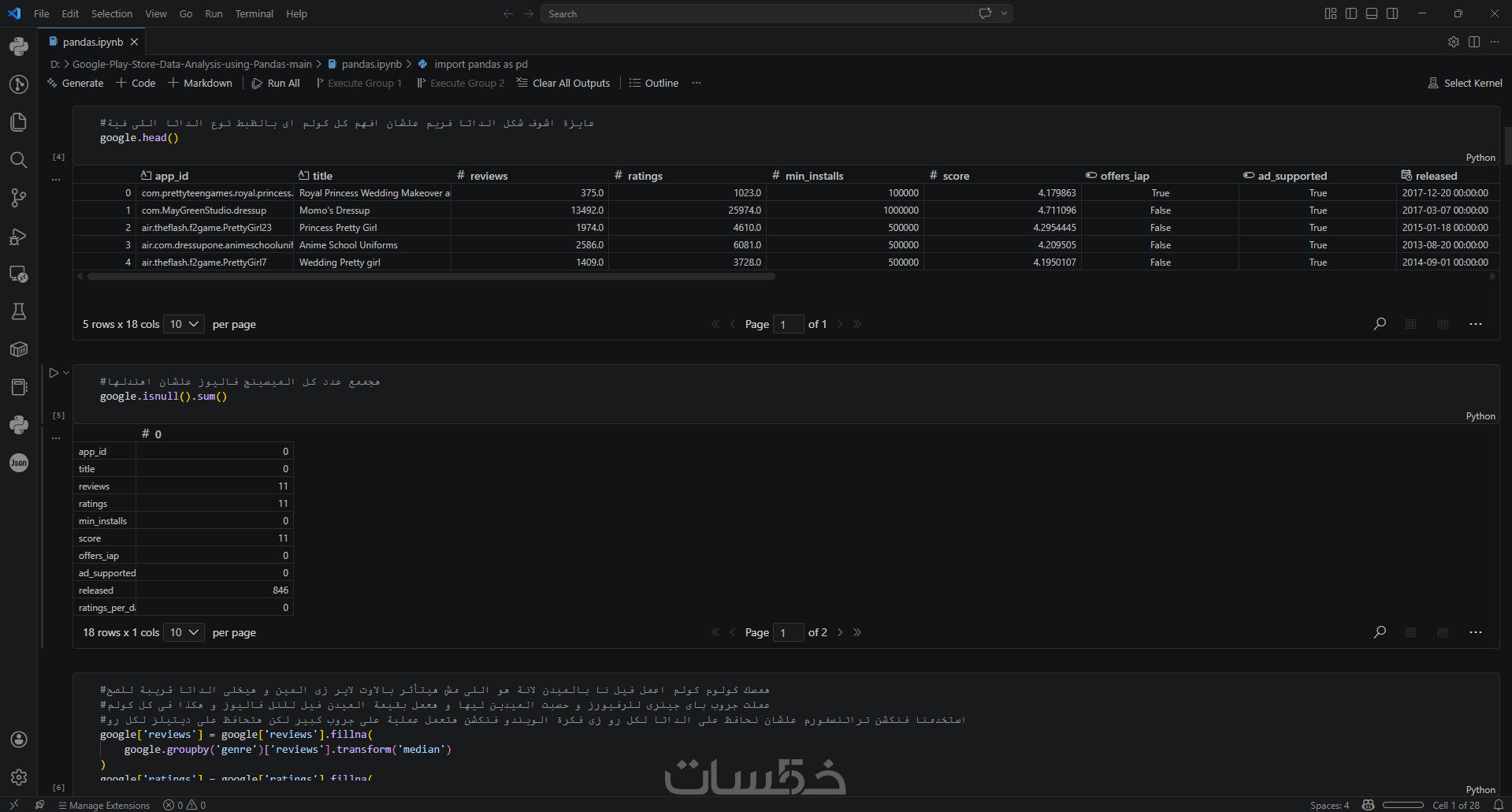

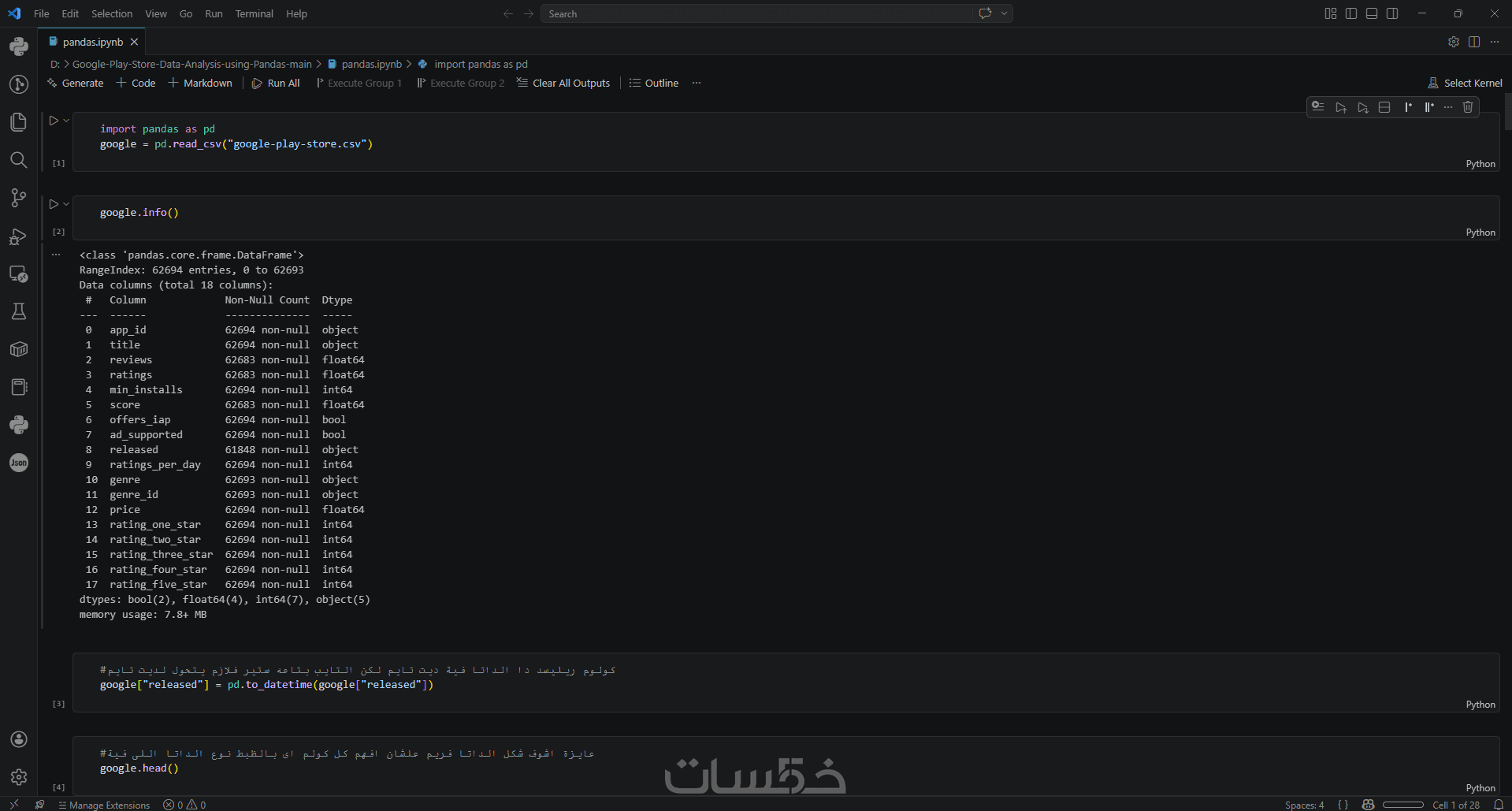

استخراج البيانات من CSV / Excel / API

تنظيف البيانات ومعالجتها

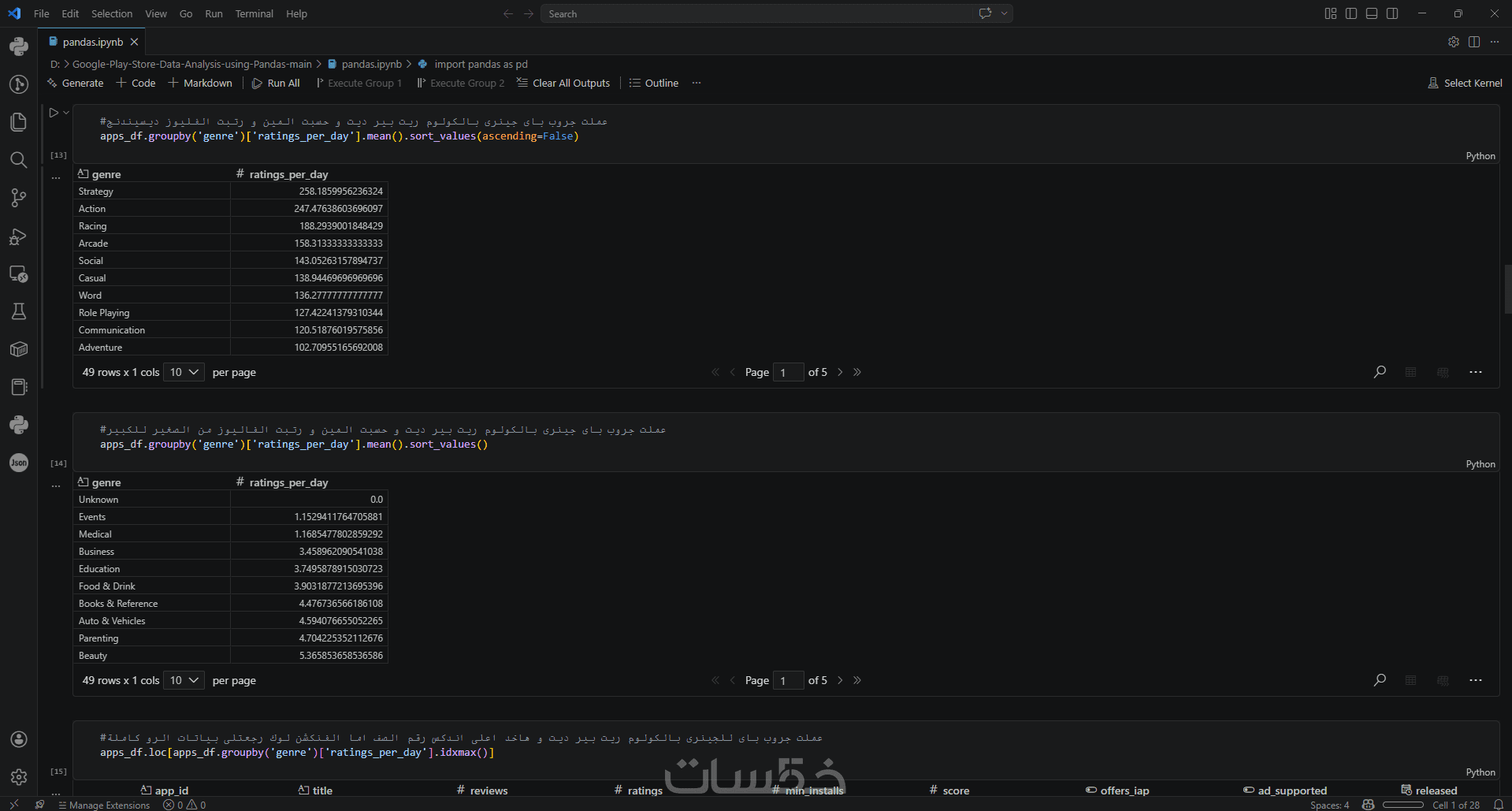

تحويل البيانات وتنظيمها

إنشاء Output جاهز للتحليل

تسليم كود Python منظم وسهل التعديل

يمكن تطوير الخدمة لتشمل:

قواعد البيانات SQL

أتمتة التشغيل Scheduling

ربط أكثر من مصدر بيانات

إنشاء ETL Pipeline متكامل

التعامل مع أحجام بيانات أكبر

هذه الخدمة مناسبة إذا كنت:

تريد أتمتة عمليات البيانات المتكررة

تعاني من أخطاء العمل اليدوي

تحتاج تجهيز بياناتك للتحليل أو Dashboard

تريد Workflow احترافي لمعالجة البيانات

الأدوات المستخدمة

Python – Pandas – SQL – APIs

مميزات الخدمة

مميزات الخدمة

كود نظيف ومنظم وسهل التعديل

حل مخصص حسب احتياج مشروعك

تقليل الأخطاء البشرية في البيانات

تسليم سريع والالتزام بالمواعيد

تواصل مستمر وتحديثات خلال التنفيذ

قابلية تطوير الـ Pipeline مستقبلًا

دعم بعد التسليم للتعديلات البسيطة

ما الذي ستستلمه

ما الذي ستستلمه

عند طلب الخدمة، ستحصل على:

كود كامل للـ Data Pipeline باستخدام Python

بيانات نظيفة ومنظمة وجاهزة للاستخدام

ملف Output (CSV / Excel) أو تحميل إلى Database

شرح مبسط لكيفية تشغيل واستخدام الكود

(حسب الباقة) إعداد تشغيل تلقائي (Automation / Scheduling)