تحليل بيانات مبيعاتك وتصنيف عملائك برمجياً باستخدام Python

تحليل بيانات مبيعاتك وتصنيف عملائك برمجياً باستخدام Python

وصف الخدمة

هل تضيع الكثير من الوقت في نسخ البيانات يدوياً من المواقع؟ هل تحتاج لجمع آلاف المنتجات أو المقالات أو بيانات التواصل لبناء قاعدة بياناتك؟ أنا هنا لأقوم بهذه المهمة الصعبة بدلاً منك.

بصفتي متخصصاً في برمجة سكريبتات Python، أقدم لك حلاً ذكياً لسحب البيانات (Web Scraping) من أي موقع ويب تريده (مثل AP News، مواقع التجارة الإلكترونية، أو الأدلة التجارية) بدقة متناهية وسرعة فائقة.

مميزات الخدمة

ما الذي سأقدمه لك في هذه الخدمة؟

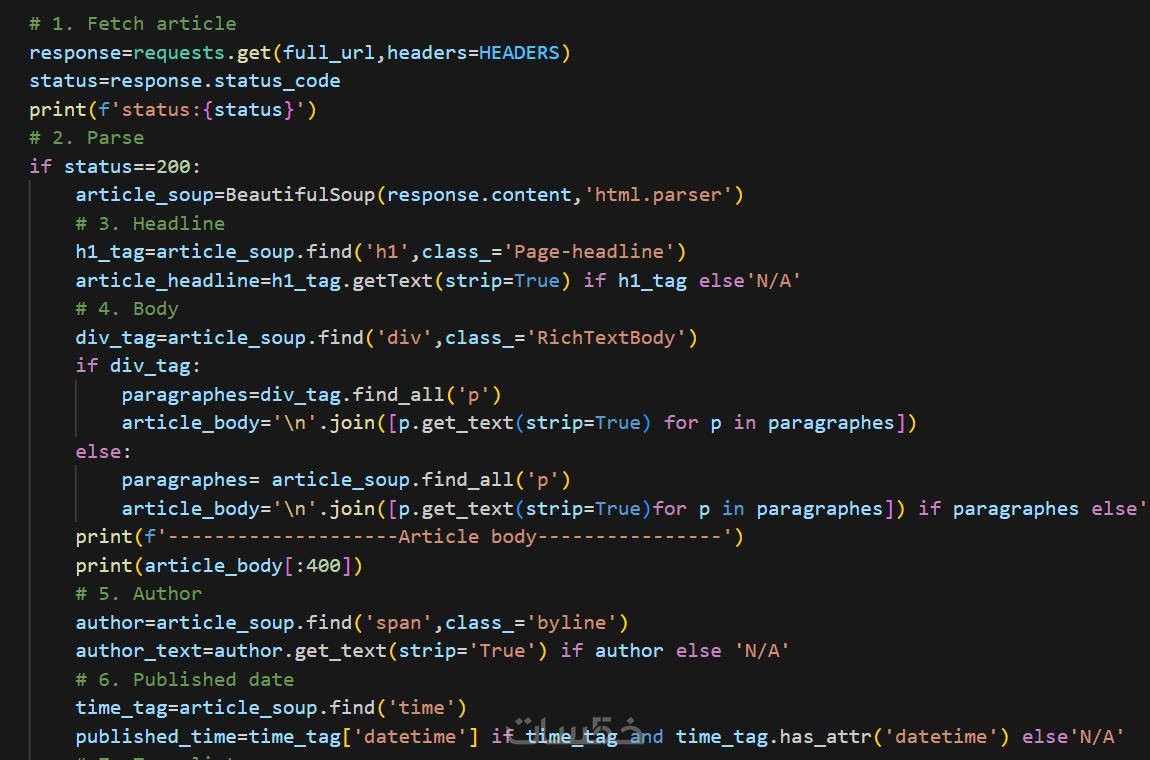

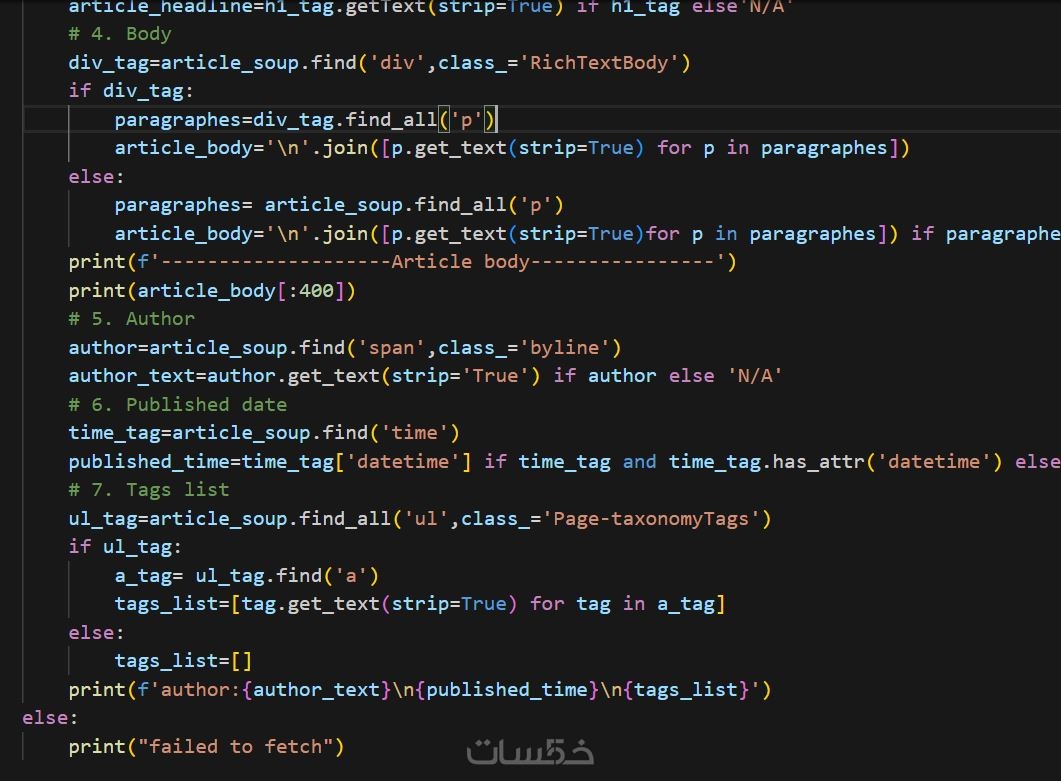

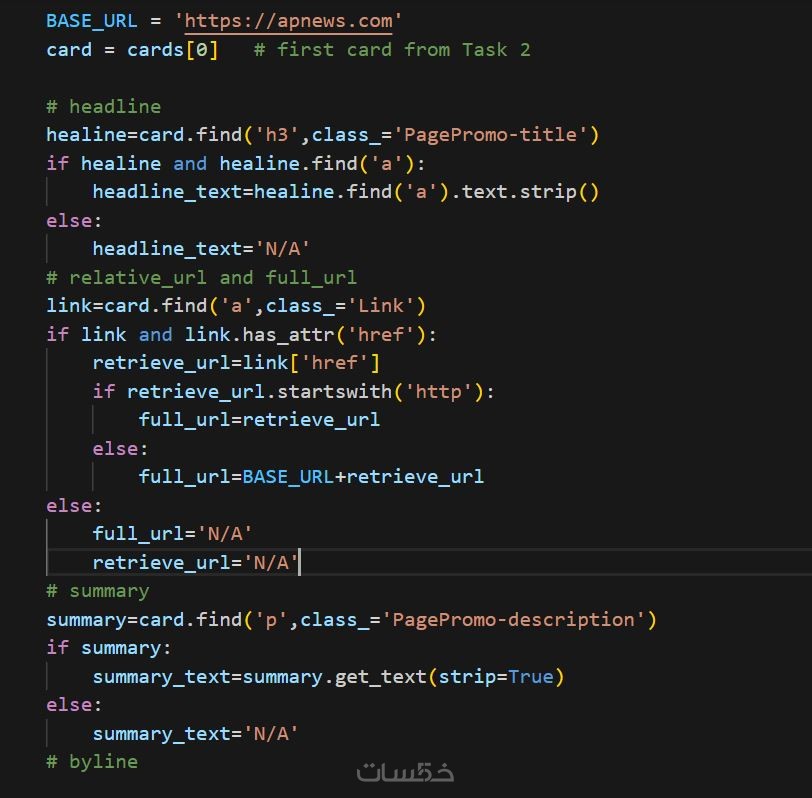

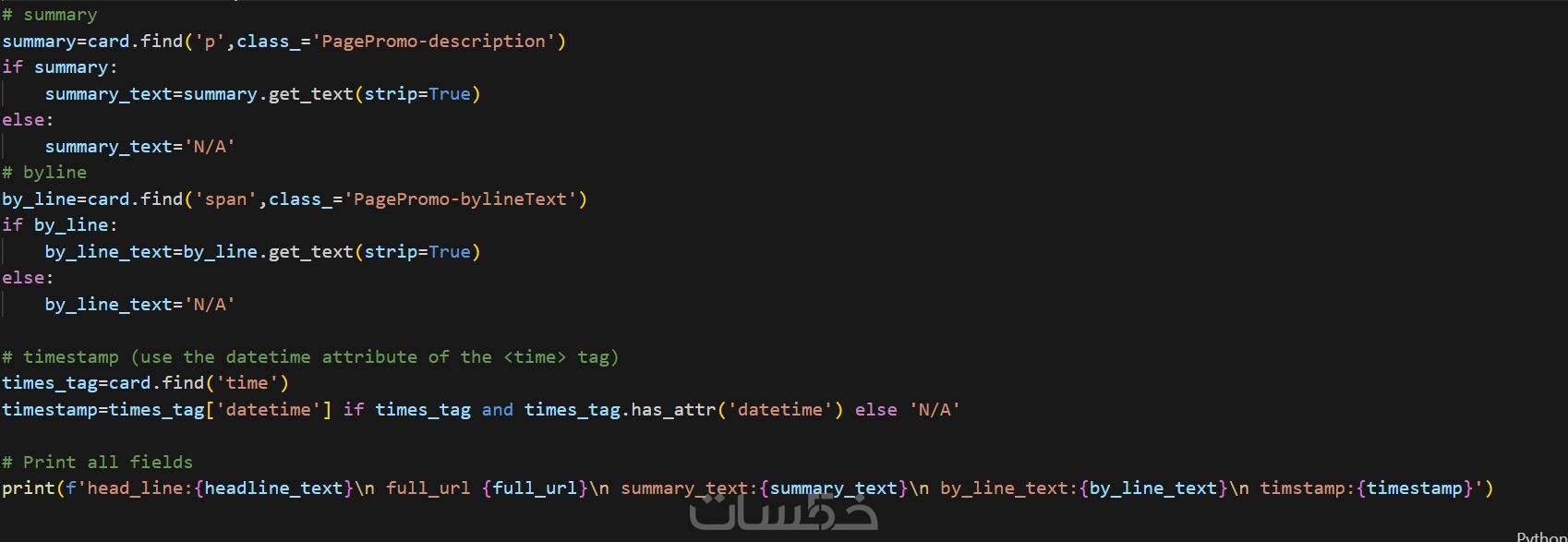

استخراج شامل: سحب العناوين، المحتوى، التواريخ، الروابط، وأي تفاصيل أخرى تحتاجها (كما يظهر في نماذج أعمالي من سحب المقالات والـ Tags).

تنظيم احترافي: سأقوم بتسليمك البيانات في ملف (Excel أو CSV) منظم بدقة ليكون جاهزاً للاستخدام فوراً.

كود نظيف وذكي: أستخدم مكتبات قوية مثل BeautifulSoup و Requests لضمان الحصول على البيانات حتى لو كان هيكل الموقع معقداً.

معالجة البيانات: لن أكتفي بسحب البيانات فقط، بل سأقوم بتنظيفها من أي رموز زائدة لتكون واضحة ومفهومة.

ما الذي ستستلمه

ملف البيانات النهائي (الداتا)

سأقوم بتسليمك ملف Excel مرتباً يحتوي على كافة البيانات المستخرجة بدقة، مع ضمان خلو النصوص من الرموز البرمجية الزائدة (Data Cleaning)، لتكون الداتا جاهزة للاستخدام المباشر في مشروعك.

حجم العمل: سحب البيانات من موقع واحد بحد أقصى 300 سجل/صفحة.

المحتوى: استخراج حتى 5 حقول مختلفة (مثلاً: العنوان، التاريخ، الكاتب، المحتوى، الرابط)

المواصفات الفنية:

تسليم البيانات في ملف Excel أو CSV منظم تماماً.

تنظيف البيانات من أي رموز برمجية أو نصوص غير مرغوب فيها.